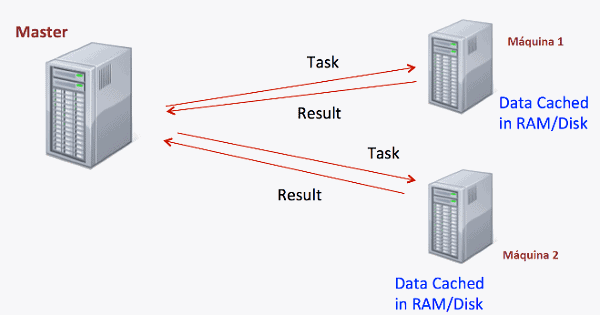

Apache Spark es un software que se encarga de distribuir o paralelizar los datos a la hora de analizarlos. Hoy en día se habla mucho de la paralelización de los datos en diferentes máquinas para procesar la información más rápido, ¿pero realmente que es eso? Paralelizar los datos en diferentes máquinas no es más que […]